Dokumente übersetzen. Daten behalten.

Contributors

Geschätzte Implementierungszeit

Verwendete Bibliotheken

- @operaide/ai

- @operaide/aktor

- pdf.js

- pdf-lib

- zod

LLM-Anbieter und -Modelle

- On-prem hosted open source models

- Configurable via settings

Externe Dienste

- None

TAGS

Introduction

Eine DeepL-ähnliche Übersetzungserfahrung, die vollständig auf deiner Infrastruktur läuft. Lade ein PDF hoch oder füge Text ein, wähle deine Sprachen und erhalte ein übersetztes Dokument mit erhaltenem Originallayout — inklusive Seite-an-Seite-Ansicht, synchronisierter Hervorhebung und PDF-Export mit einem Klick. Da die KI on-prem läuft, verlassen keine Daten deine Umgebung — ideal für vertrauliche Dokumente, Rechtstexte und interne Kommunikation.

Business Impact

Herausforderung

Die Übersetzung interner Dokumente über Cloud-Dienste wie DeepL oder Google Translate wirft Datenschutzfragen auf — vertrauliche Inhalte verlassen die Organisation.

Lösung

Eine selbst gehostete Übersetzungs-App, betrieben mit on-prem Open-Source-Modellen, bietet die gleiche Nutzererfahrung, ohne dass Daten die Infrastruktur verlassen.

Ergebnis

Übersetzung auf Enterprise-Niveau mit voller Datenhoheit — vertrauliche Dokumente bleiben on-prem, während Nutzer eine vertraute, professionelle Übersetzungsoberfläche erhalten.

Funktionsweise

- PDF-Übersetzung — Lade ein PDF per Drag-and-Drop hoch. Das übersetzte Dokument erscheint Seite an Seite mit dem Original, mit synchronisierter Hervorhebung, sodass du jeden Satz zur Quelle zurückverfolgen kannst.

- Freitext-Übersetzung — Wechsle in den Textmodus, füge Inhalte ein und übersetze direkt. Gleiche Sprachunterstützung, kein Dokument-Upload nötig.

- PDF-Export — Exportiere den übersetzten Inhalt als PDF mit erhaltenem Originallayout. Bereit zum Teilen oder Archivieren.

- Volle Datenhoheit — Läuft auf deiner eigenen Infrastruktur mit on-prem gehosteten Modellen. Keine Daten verlassen deine Umgebung — geeignet für vertrauliche, rechtliche und interne Dokumente.

- 11+ Sprachen — Unterstützt Deutsch, Englisch, Spanisch, Französisch, Italienisch, Portugiesisch, Niederländisch, Polnisch, Russisch, Japanisch, Chinesisch und weitere — mit automatischer Quellspracherkennung.

Technische Details

- Snippet-basierte Übersetzung — Die eigene UI nutzt pdf.js, um Textschnipsel mit vollständigen Positionsmetadaten aus dem PDF zu extrahieren. Schnipsel werden zu Sätzen gruppiert und einzeln über parallele Requests an die Reaktor-API übersetzt. Niedrige Temperatur (0.2) sorgt für konsistente, wörtliche Übersetzungen.

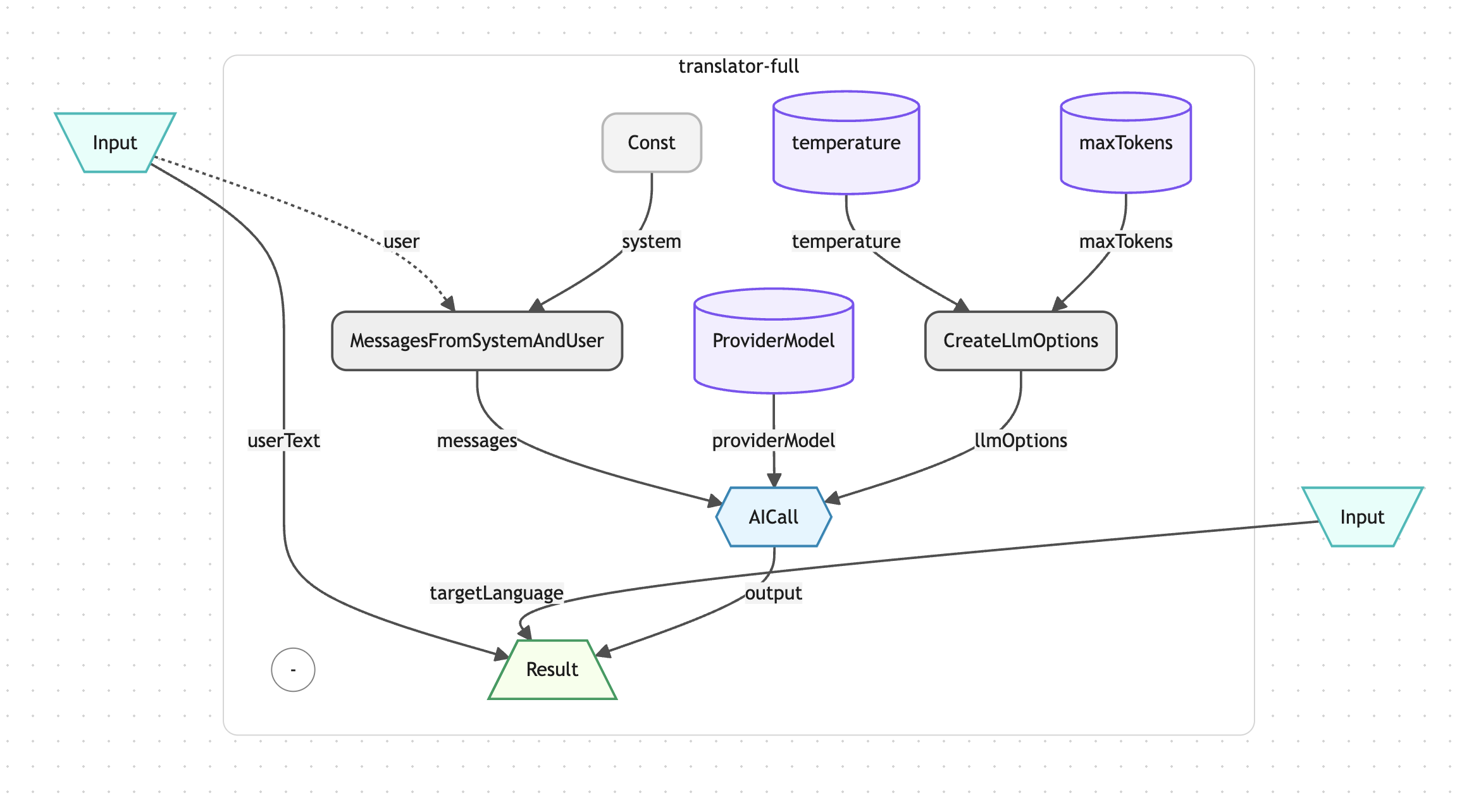

- LLM-basierte Übersetzungspipeline — Jede Übersetzungsanfrage durchläuft aktorCreateSystemPrompt (sprachspezifische Regeln), aktorMessagesFromSystemAndUser (Prompt-Formatierung) und aktorAICall (LLM-Aufruf). Der System-Prompt erzwingt strikte Regeln: nur übersetzen, Formatierung beibehalten, Zahlen und Symbole unverändert lassen, Text ohne Erklärung zurückgeben.

- Anbieterunabhängige Architektur — aktorAISettingProviderModel abstrahiert den LLM-Anbieter. Derselbe Reaktor funktioniert mit on-prem Open-Source-Modellen, Azure OpenAI oder jedem anderen in Operaide konfigurierten Anbieter — keine Codeänderungen nötig, nur eine Einstellungsänderung.

- Integrierte eigene UI — Das public/-Verzeichnis liefert eine vollständige Übersetzungsoberfläche: Drag-and-Drop-Upload, Sprachauswahl, Seite-an-Seite-Vorschau mit synchronisierter Hervorhebung, Einstellungsdialog und PDF-Export. Die UI ruft den REST-Endpunkt des Reaktors mit Operaide-Authentifizierung auf — keine separate Frontend-Infrastruktur erforderlich.

- PDF-Rekonstruktion — pdf-lib übernimmt die Exportphase: Übersetzter Text wird gemäß den Original-Layout-Metadaten positioniert, Schriftarten werden eingebettet, und das Ergebnis ist als neues PDF mit Übersetzungen an der richtigen Stelle herunterladbar.

Reaktor-Architektur

Die Translator-App registriert zwei Reaktoren mit einer gemeinsamen eigenen UI. Der Snippet-Übersetzer-Reaktor verarbeitet einzelne Textschnipsel: Er empfängt Quellsprache, Zielsprache und Inhalt, erstellt einen strikten System-Prompt über aktorCreateSystemPrompt, formatiert die Nachrichten mit aktorMessagesFromSystemAndUser, setzt LLM-Optionen (Temperatur 0.2, max. Tokens 1000) über aktorCreateLlmOptions und ruft aktorAICall mit dem konfigurierten Anbietermodell auf. Der Volltext-Reaktor folgt dem gleichen Muster mit etwas höherer Temperatur (0.3) und Token-Limit (2000) für Gesamtdokument-Übersetzungen. Die eigene UI in public/ orchestriert den Workflow: Sie parst PDFs mit pdf.js, sendet parallele Übersetzungsanfragen an den Snippet-Übersetzer, rendert Ergebnisse als Markdown mit synchronisierter Hervorhebung und exportiert übersetzte PDFs über pdf-lib.

Bereit zur Auslieferung von KI

Das funktioniert?

Erfahren Sie, wie Operaide Teams dabei hilft, zuverlässige KI-Anwendungen schneller bereitzustellen. Vom Prototyp bis zur Produktion — mit vollständiger Kontrolle und europäischer Souveränität.